안녕하세요?

인공지능이 가지가지로 화두이기는 한데, 이에 대한 우려도 크기는 큽니다. 가장 SF의 고전적인 클리셰로는 '인공지능의 반란'같은 것이 있기는 있습니다. 특히 터미네이터 시리즈는 이런 인공지능의 반란이 나온 전형적인 영화의 이야기 이기도 합니다. 하지만, 반란까지는 아니더라도 인간을 능가하는 인공지능은 가지가지로 우려 스럽기는 합니다.

그래서 그런지는 몰라도 2017년 1월에 미국 캘리포니아 주 아실로마(Asilomar)에 많은 인공지능 연구자가 모여 회의를 하였고, 인공지능을 개발할 때 지켜야 하는 원칙 23가지를 발표 하였다고 합니다. 이 원칙들이 강제성이 없기는 하지만, 전세계 3000명 이상의 연구자들이 동의한 내용이라고는 합니다.

먼저 연구과제에 대한 5가지를 보자면, 처음부터 건전한 방향으로 연구가 이루어지며, 연구자들 끼리 '이익'에 눈멀지 않도록 안전 장치에 신경을 쓰자는 것으로 해석할 수 있습니다. 그러면서 아실로마 원칙은 다음 13개의 윤리와 가치에 대해서도 정의를 하고 있습니다.

일단 윤리와 가치 부분의 장황한 설명이 있었는데, 가장 큰 몇가지 원칙만을 이야기 하자면, 우선 인간을 위해 존재하되, 소수의 이익을 독점하기 위해 사용해서는 안되고, 군사적인 목적으로는 사용해서는 더는 안된다는 점을 강조하고 있습니다. 다만 이런 군사적인 이용의 제한이 과연 잘 지켜 질지는 모르겠다는 생각이 듭니다.

마지막으로 장기적인 과제입니다. 결국 인공지능의 발전을 장기적으로 어떻게 계속 모니터링 할 것이냐에 대해서 이야기를 하고 있는데, 제 생각에는 '인공지능'이라는 것도 결국에는 '계산기'에 불과한 지금에는 그렇게 크게 위험할까 하는 생각이 들기도 합니다.

'과학 토막상식 이야기' 카테고리의 다른 글

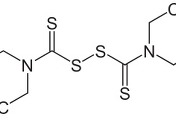

| 말은 들어 봤지만, 잘은 몰랐는 CLA (0) | 2018.02.15 |

|---|---|

| 알콜 중독 치료제에 항암 효과도 있다? (0) | 2018.02.14 |

| 인공지능이 어떻게 번역을 하는가? (0) | 2018.02.02 |

| 딮러닝과 무엇이 다른지 잘 감은 안오는 기계학습 (0) | 2018.01.29 |

| 말은 많이 들었지만, 잘은 몰랐는 '딮 러닝(Deep Learning)' (0) | 2018.01.23 |