안녕하세요?

Newton 2018년 1월호 기사를 보니, Google(구글)의 무료 자동번역 기능에 딥러닝이 도입되면서 번역의 질이 크게 올라갔다고 합니다. 그런데 지난번 포스팅에서 언급을 하였는 딮러닝은 화상 이미지를 인식하는데 사용이 되었습니다.

링크 : 말은 많이 들었지만, 잘은 몰랐는 '딮 러닝(Deep learning)'

그럼 이 딮러닝을 이미지 인식이 아닌 언어간의 번역에 사용하는 것은 어떻게 된 것인지에 대해서 이번 포스팅에서 아주 간략하게 나마 다루어 보고자 합니다.

먼저 언급해야 하는 내용으로는, 이 인공지능의 하나인 '딥러닝'이 제대로 된 번역을 하기 위해서는 우선 사람이 번역을 해 놓은 대량의 번역 데이터가 필요 하다고 합니다. 여기서 이전에 포스팅에서 언급을 한 적이 있는 '기계학습'에 관한 것이 등장을 하기도 합니다.

링크 : 딮러인과 무엇이 다른지 잘 감은 안오는 기계학습

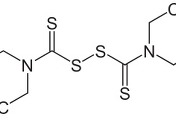

먼저 위 링크를 읽어 주시면, 어떻게 '기계학습'이 이루어 지는 지에 대해서 나와 있습니다. 위 과정에서 이렇게 이미지를 나누어서 서로 점수를 매긴 것처럼, 번역에서도 이런 점수를 매기는 메커니즘을 이용, 아래와 같은 과정을 거치면서 문장을 하나 번역 한다고 합니다.

위 그림의 묘사처럼, 문장 하나의 낱말 하나하나를 일종의 숫자로 만든 데이터로 변환한 다음, 정확한 메커니즘은 모르지만, 인간이 했는 번역을 보면서 가장 높은 점수의 결과를 찾아가서 번역을 하나하나 한다고 합니다. 결국 문장을 번역하는 것은 자연스럽게 되기는 하지만, 아직 문제가 하나 있다고 합니다.

바로 '문장'은 자연스럽게 번역을 하는데는 성공하였지만, '전체 문장'이라고 해야 할까요? 문맥상의 의미를 찾고, 이에 대해서는 제대로 된 번역이 아직 나오지않는다고 합니다. 즉, 한 문장 단위의 번역만이 가능하기 때문에, 전체적인 모든 문맥을 이해하는 데는 아직은 무리가 있다고 합니다.

이런 점에서 당분간은 번역가가 필요로 하겠지만, 과거에 비해서 그 역할이 많이 줄어 들었다고 해야 할 듯 합니다. 일단은 번역 전문가의 수요 자체는 이 인공지능의 도움에 의해서 많이 줄어들 수는 있어 보입니다만, 아직은 인공지능이 모든 번역을 다 완벽하게 할 수는 없어 보입니다. 한마디로 구글의 번역기가 상당히 강력한 도구이기는 한데, 아직까지는 인간의 역할을 100% 제외할 수는 없어 보인다는 것입니다.

'과학 토막상식 이야기' 카테고리의 다른 글

| 알콜 중독 치료제에 항암 효과도 있다? (0) | 2018.02.14 |

|---|---|

| 아실로마의 인공지능 23원칙 (0) | 2018.02.03 |

| 딮러닝과 무엇이 다른지 잘 감은 안오는 기계학습 (0) | 2018.01.29 |

| 말은 많이 들었지만, 잘은 몰랐는 '딮 러닝(Deep Learning)' (0) | 2018.01.23 |

| 콘택트 렌즈에 대한 토막상식 (0) | 2018.01.12 |